Les « deepfake » sont des trucages de vidéos ou d’images reposant sur l’Intelligence Artificielle (IA) et qui permettent de superposer des fichiers sur d’autres fichiers existants. Ils sont souvent utilisés pour créer de fausses informations (infox) ou des canulars plutôt malveillants. Alors qu’ils se limitaient aux images et vidéos, Microsoft vient de dévoiler VALL-E, un système de synthèse vocale capable de reproduire une voix humaine en trois secondes seulement à partir d’un simple échantillon audio. Cette IA peut également reproduire les intonations, le timbre et les émotions, propres à chaque individu. Révolution technologique ou danger ? On va tout vous expliquer.

À quoi peut servir VALL-E ?

L’équipe de Microsoft, l’inventeur de ce nouveau système, pense que ce système servirait potentiellement à des applications de synthèse vocale. Le problème étant qu’il pourrait par ailleurs servir à des personnes malveillantes, à usurper une identité. Par exemple, un discours politique pourrait être modifié à l’insu de l’intéressé, et donc transmettre un message contraire à celui d’origine. En effet, il serait possible d’éditer et de modifier le son à partir d’une transcription textuelle d’un discours.

Comment ça marche ?

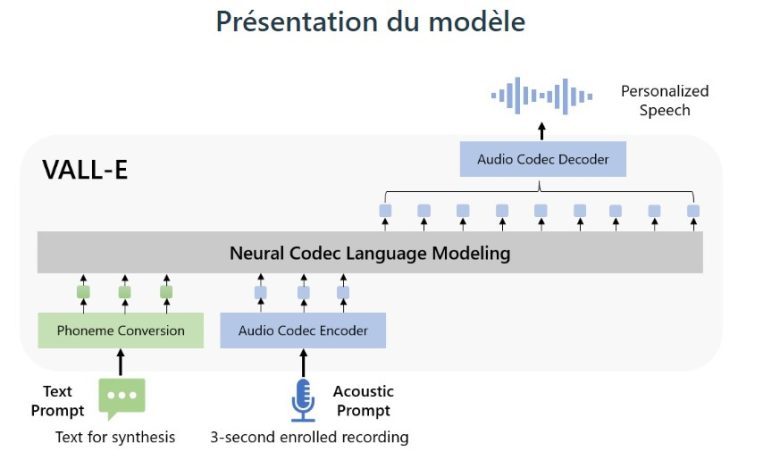

Le concept de VALL-E fonctionne grâce à ce que l’on appelle un « modèle de langage de codec neuronal » et s’appuie sur une technologie de compression audio appelée Encodec, dévoilée par Meta (Facebook) en octobre dernier. Les méthodes de synthèse vocale déjà utilisées manipulent des ondes. En revanche, VALL-E, lui, génère directement des codecs audios à partir d’échantillons acoustiques et textuels. En d’autres termes, il analyse le son de la voix, le décompose en jetons (token) avec Encodec puis utilise le « machine learning » afin qu’il corresponde à la voix analysée. Pour réaliser cette prouesse technologique, VALL-E s’appuie sur une gigantesque bibliothèque sonore (Librilight) contenant plus de 60 000 heures de discours provenant de plus de 7000 personnes parlant anglais. La base de données provient principalement de la librairie Librivox qui propose gratuitement des livres audios.

De nombreux exemples diffusés par Microsoft

Sur le site Valle-Demo, on peut découvrir des dizaines d’exemples de phrases conçues par l’IA de VALL-E et certaines sont assez effrayantes par leur ressemblance avec la voix réelle. Le système montre aussi ses limites, car certaines voix ne sont pas vraiment convaincantes, trop synthétiques et repérables par l’oreille humaine. Certains exemples montrent également que différentes intonations peuvent être reproduites par VALL-E.

Microsoft, conscient des risques de VALL-E

La firme américaine explique être consciente du danger que pourrait représenter cette nouvelle invention. C’est la raison pour laquelle aucun code source n’a été diffusé, en tout cas, jusquà maintenant. Microsoft affirme aussi être en train de développer un autre logiciel qui détecterait les clips audios réalisés par VALL-E et se veut rassurante sur ce point. « Comme VALL-E pourrait synthétiser la parole et l’identité du locuteur, il comporte potentiellement des risques en cas d’utilisation abusive du modèle, comme l’usurpation d’identité vocale ou l’usurpation de l’identité d’un locuteur spécifique ». Nous avons mené les expériences sous l’hypothèse que l’utilisateur accepte d’être le locuteur cible en synthèse vocale. « Si le modèle est généralisé dans le monde réel, il devrait inclure un protocole pour s’assurer que le locuteur approuve l’utilisation de sa voix et un modèle de détection. » précise Microsoft dans sa déclaration d’éthique.