L’intelligence artificielle est au cœur de l’actualité ces temps-ci. Il semble qu’il ne se passe pas un jour sans qu’un leader d’opinion ne mette en garde contre le danger de cette technologie dont le rythme de développement est particulièrement rapide. Récemment, des centaines d’experts ont soutenu une déclaration du Center for AI Safety de San Francisco selon laquelle « l’atténuation du risque d’extinction (de la race humaine NDLR) lié à l’IA devrait être une priorité mondiale, au même titre que d’autres risques qui menacent la société tels que les pandémies et les guerres nucléaires ». Bref, il s’agit d’une réalité prise très au sérieux par les chercheurs et les instances gouvernementales.

Une urgence de premier plan

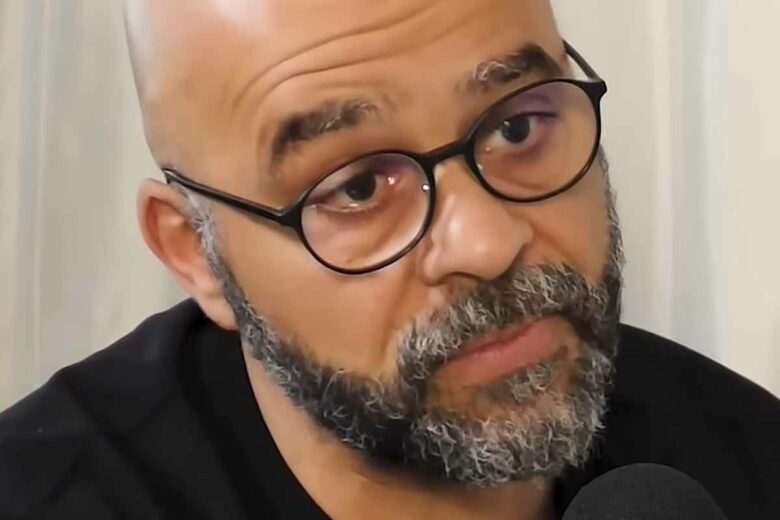

L’ancien cade de Google, Mo Gawdat, est l’un de ces experts qui se préoccupent largement de l’avenir de l’humanité face au progrès exponentiel de l’IA. Dans un entretien avec le podcasteur Stephen Bartlett dans le cadre d’une émission intitulée « The Diary of a CEO », l’homme qui était à la tête de Google X « moonshot » s’est dit très inquiet de la prolifération des technologies liées à l’intelligence artificielle. D’après lui, il s’agit d’un problème qui est « au-delà d’une urgence ». « C’est plus important que le changement climatique, croyez-le ou non », a-t-il averti.

Des risques non négligeables

Selon Gawdat, la probabilité que « quelque chose d’incroyablement perturbateur se produise au cours des deux prochaines années » est assez élevée. Ladite probabilité serait « plus grande avec l’IA qu’avec le changement climatique », a-t-il ajouté. Pire encore, les conséquences pourraient affecter tous les pays et auraient des effets dévastateurs sur la société humaine. Toujours d’après l’ancien haut responsable de la firme de Mountain View, les dangers potentiels imminents sont multiples. Ils vont des crises politiques et sociales, aux pertes d’emplois massives dues à l’automatisation des tâches, pour ne citer que ça.

Des mesures ultimes pour freiner la tendance

Dans un autre podcast intitulé « Secret Leaders », l’ancien cadre de Google a même déclaré que la probabilité que l’IA considère l’humanité comme un adversaire à éliminer à l’avenir est relativement élevée. Selon lui, au vu du rythme auquel les ordinateurs se développent actuellement, ils pourraient être capables de construire leurs propres « machines à tuer » d’ici quelques années. Force est de constater que de nombreux pays tentent désespérément de renverser la donne en prévoyant d’adopter des lois pour limiter les risques liés à l’utilisation de l’intelligence artificielle. À ce propos, Gawdat recommande la mise en place de mesures drastiques telle qu’une taxation élevée — allant jusqu’à 98 % — pour les entreprises ayant recours à ce genre d’outil pour remplacer le facteur humain.